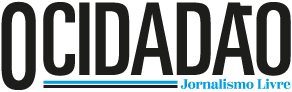

[NOTÍCIAS IA: 7/3/26] OpenAI perde clientes para o Pentágono, Anthropic pede desculpa por ser “boazinha”, Google atira bananas à parede e a Perplexity quer vender-te uma caixa mágica.

Acabou a lua de mel. Se até agora vivíamos na ilusão de que as empresas de IA eram guardiãs da moralidade humana, os últimos sete dias trataram de arrancar essa máscara com a delicadeza de um sargento da tropa.

Como tenho vindo a repetir no podcast «IA&EU» até ficar rouco: não antropomorfizem empresas. Elas não são vossas amigas. Elas têm accionistas. E esta semana, ficou claro que o maior accionista moral de todos chama-se “Complexo Militar-Industrial”. Entre cancelamentos em massa, pedidos de desculpa humilhantes e hardware duvidoso, esta foi a semana em que a IA perdeu a inocência e agarrou na arma.

Vamos ao massacre…

OpenAI: O “Êxodo” dos Idealistas

A OpenAI decidiu finalmente sair do armário e assumir a sua relação com o Pentágono. O resultado? Um êxodo massivo de subscritores (2,5 milhões deles).

As redes sociais encheram-se de screenshots de cancelamentos do ChatGPT Plus. A narrativa é simples: “Não quero o meu dinheiro a financiar drones autónomos”. É um movimento bonito, principesco, quase romântico.

Mas sejamos realistas: o Sam Altman não quer saber dos vossos 20 euros mensais quando tem contratos de defesa de milhares de milhões na mesa. A OpenAI fez as contas e percebeu que a guerra paga melhor que a poesia sobre gatos ou políticos. A reação dos utilizadores é compreensível, mas ingénua. A ferramenta que usam para resumir PDFs é a mesma que vai optimizar logística militar. O ChatGPT vestiu a farda, e quem não gostar, que feche a porta à saída.

Anthropic: O Hipócrita Acidental

E para onde fugiram esses utilizadores revoltados? Para a Anthropic, claro! A “casa da IA ética”, a “Constitutional AI”, os “bons da fita”.

Só que a festa durou, literalmente, 48 horas.

Depois de verem um influxo de utilizadores a fugir da OpenAI, a Anthropic (numa jogada de mestre de comédia trágica) veio a público fazer uma vénia ao Pentágono.

Aparentemente, depois do ultimato da semana passada (onde o Departamento de Defesa se queixou dos guardrails excessivos do Claude), a Anthropic decidiu “clarificar” a sua posição. Tradução: “Desculpem lá se o nosso robô é demasiado pacifista, nós prometemos que ele também sabe ser duro se o cheque for grande.”

Foi o momento “ooops” do ano. A Anthropic tentou jogar nos dois tabuleiros — agradar aos utilizadores éticos e aos generais — e acabou por não agradar a ninguém. Ficou provado que, quando a pressão aperta, a “Constituição” do Claude é tão flexível quanto uma vara de bambu.

Google: A Banana Continua a Reinar

Enquanto os outros dois se embrulham em lençóis éticos, a Google continua focada na única coisa que importa: escala.

O lançamento global do modelo Nano Banana 2 (sim, o nome continua a ser ridículo) está a cimentar a Google como a rainha da eficiência.

Não estão preocupados com a moral do Pentágono neste momento; estão preocupados em meter um modelo de IA em cada telemóvel Android do planeta que funcione offline e custe zero em servidores.

É a estratégia da “canalização”. Enquanto a OpenAI e a Anthropic discutem filosofia, a Google está a instalar os canos. E, meus caros, quem controla os canos, controla a água.

Perplexity: O Computador que Ninguém Pediu?

E no meio deste tiroteio, a Perplexity decidiu lançar… hardware.

Apresentaram o “Perplexity Computer”. Não é um portátil, não é um telemóvel. É uma “caixa de respostas”. Um dispositivo dedicado a… pesquisar.

Aqui entre nós: isto cheira a Rabbit R1 e Humane Pin por todo o lado. Lembram-se desses? Exato, ninguém se lembra porque foram falhanços colossais.

A ideia de que precisamos de um gadget específico para fazer perguntas à IA, quando já temos um supercomputador no bolso (o telemóvel), é o tipo de delírio de Silicon Valley que me faz questionar se esta gente sai à rua.

É giro? É. Vai vender? Talvez aos early adopters que gostam de pisa-papéis caros. Mas é uma distração. A IA é software, é infraestrutura. Tentar encapsulá-la numa caixa bonita é tentar vender rádio num mundo de Spotify.

Conclusão: Escolham o Vosso Veneno

Esta semana ensinou-nos que não há “bons da fita”.

Se usam OpenAI, estão a financiar a defesa.

Se usam Anthropic, estão a financiar alguém que quer financiar a defesa, mas tem vergonha de admitir.

Se usam Google, estão a dar os vossos dados à maior máquina de publicidade da história.

A IA é uma ferramenta poderosa, mas a indústria que a produz está moralmente falida ou, no mínimo, altamente comprometida.

O meu conselho? Deixem de procurar heróis. Usem a ferramenta que vos serve melhor, protejam os vossos dados o melhor que conseguirem e não caiam na esparrela de achar que o Claude ou o ChatGPT são vossos amigos. Eles são mercenários. E, a partir desta semana, já nem sequer tentam esconder.

Se querem navegar este caos com a cabeça no lugar, subscrevam o meu substack ou acompanhem as minhas crónicas no jornal “O CIDADÃO”. Aqui analisa-se a tecnologia com a frieza que ela exige, e com o humanismo que ela não tem.

Até para a semana, e cuidado para não tropeçarem na caixa da Perplexity.

Artigo publicado simultaneamente n’ O Cidadão e no substack do autor

Autor | Formador Psicossocial | Consultor

Criador de Conteúdos | Especialista em Inteligência Artificial