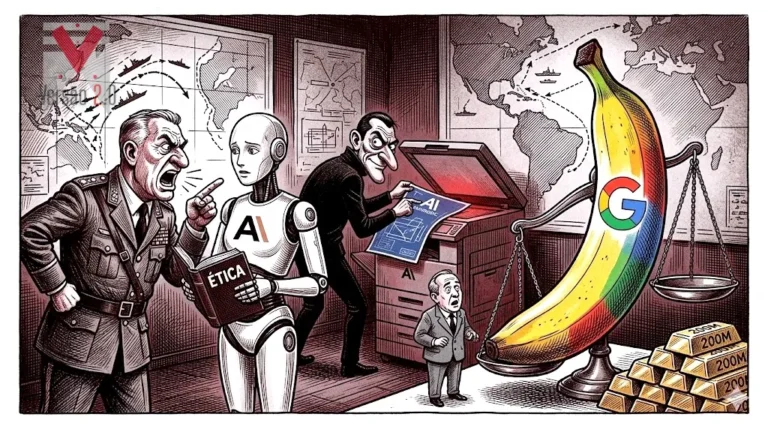

Espiões, Generais e Bananas: A Semana em que a IA Foi à Guerra

A inocência acabou.

Se ainda achavam que a Inteligência Artificial era sobre vos ajudar a escrever emails ou a criar imagens giras, a última semana tratou de destruir essa ilusão. Estamos a continuar a fase da “Industrialização Militar e Corporativa”.

Como costumo avisar no podcast «IA&EU», quando o dinheiro a sério (e as armas a sério) entram em campo, as regras mudam. Esta semana, vimos a Anthropic a vestir a pele de detetive, a OpenAI a vestir o fato e gravata das grandes consultoras, e o Pentágono a perder a paciência com a moralidade dos robôs.

Vamos descascar esta banana 🍌(literalmente, já vão perceber), porque o sumo desta semana é ácido.

Anthropic: O Detetive e o General

Primeiro, apanharam laboratórios chineses com a boca na botija. Aparentemente, o Claude não é apenas bom a escrever código; é bom a ser copiado. A Anthropic revelou provas de que modelos chineses estão a usar técnicas de engenharia reversa para “clonar” o comportamento e os pesos do Claude.

Isto é a confirmação do que já se suspeitava: na geopolítica da IA, “inovação” muitas vezes escreve-se “Ctrl+C, Ctrl+V”. A China não quer apenas competir; quer atalhar caminho. E a Anthropic, com a sua arquitetura focada em segurança, tornou-se o alvo preferencial.

Irónico se pensarmos que uma empresa acusada de roubar direitos intelectuais está a queixar-se de alguém lhe estar a roubar o produto roubado.

Mas o problema da Anthropic não vem só do Oriente. Vem de casa.

O Pentágono (sim, o Departamento de Defesa dos EUA) lançou um ultimato à empresa. O motivo? O Claude é “demasiado ético” para a guerra.

Imaginem um general a pedir uma estratégia de defesa tática e o Claude a responder: “Desculpe, mas como modelo de linguagem treinado pela Anthropic, não me sinto confortável a discutir violência.”

O Pentágono quer guardrails (barreiras de segurança) que funcionem para civis, mas que possam ser desligados para militares. A tensão entre “Safety AI” (a imagem de marca da Anthropic) e “Weaponized AI” nunca foi tão palpável. A Anthropic vai ter de decidir: mantém a sua moral intocável ou aceita os contratos milionários da defesa? Para já… a Anthropic negou-se aos caprichos do Pentágono!

OpenAI: Os Fatos Cinzentos e o Cheque de 200 Milhões

Anunciaram parcerias estratégicas com as gigantes da consultoria (pensem nas McKinseys e Deloittes deste mundo) para implementar os seus novos “Frontier Agents” nas empresas Fortune 500.

O que é que isto significa para ti? Significa que a próxima vez que fores dispensado ou que o teu processo for “optimizado”, não foi o Sam Altman que carregou no botão; foi um consultor de fato cinzento que instalou um Agente da OpenAI para fazer o teu trabalho. A IA saiu do laboratório e entrou na sala de reuniões.

E para garantir que continuam no topo, a OpenAI sacou da carteira. Contrataram um executivo de topo da Meta (responsável pelo modelo Llama) por um pacote que supera os 200 milhões de dólares.

Leram bem. 200 milhões por um cérebro humano.

Isto é a prova de que a “bolha” de talento não rebentou; está mais inchada que nunca. Estamos numa guerra de talento onde um investigador de IA vale mais do que equipas inteiras de futebol. É obsceno? Talvez. Mas é o preço do trono.

Google: A “Nano 🍌 Banana” que Escorrega nos Gigantes

Sempre com o seu timing peculiar, lançaram o Nano Banana 2 (sim, o nome é ridículo, mas a tecnologia é séria).

Este é um modelo pequeno (SLM – Small Language Model) que promete performance de topo a metade do custo dos concorrentes.

A Google percebeu algo fundamental: nem toda a gente precisa de um Ferrari (Gemini Ultra) para ir comprar pão. Às vezes, uma scooter eléctrica (Nano Banana) chega e sobra, e gasta muito menos bateria.

Se este modelo cumprir o que promete e for o nº 1 na sua classe, a Google pode estar a ganhar a guerra mais importante de todas: a da eficiência. Num mundo onde a energia é escassa e cara, quem fizer mais com menos, ganha. Mesmo que chame ao seu produto “🍌Banana”.

Conclusão: A Ética é Bonita, mas a Guerra Paga Melhor

A Anthropic está a descobrir que ser “ético” é difícil quando tens espiões à porta e generais aos gritos. A OpenAI está a descobrir que para vender a empresas sérias, precisa de parceiros aborrecidos suspeitos de irem a ilhas polémicas. E a Google continua a tentar provar que ainda sabe inovar, nem que seja a dar nomes de fruta aos seus modelos.

A IA já não é sobre “futuro”. É sobre poder, agora.

O meu conselho? Não se distraiam com os nomes engraçados ou com os números de 200 milhões. Olhem para o movimento das peças: a IA está a ser militarizada e corporativizada. Usem-na como ferramenta, antes que a ferramenta (ou o consultor que a gere) vos use a vós.